Привет, друзья. Сегодня мы поговорим про индексацию: что это такое, какие существуют этапы индексации сайта, как провести проверку индексации отдельно взятой страницы или всего сайта целиком, как ускорить индексацию сайта и как ее запретить.

Привет, друзья. Сегодня мы поговорим про индексацию: что это такое, какие существуют этапы индексации сайта, как провести проверку индексации отдельно взятой страницы или всего сайта целиком, как ускорить индексацию сайта и как ее запретить.

Статья рассчитана по большей части на новичков, однако я буду делиться практическим опытом и наработками, которые будут полезны даже специалистам.

Начнем с определения – индексацией называют процесс добавления поисковиком информации о контенте сайта в свою базу. Если какая-то информация проиндексирована, то она будет участвовать в результатах поиска, и люди будут ее находить. Соответственно, если информация не проиндексирована, то через поиск найти ее будет невозможно.

- Этапы индексации сайта

- Как проверить индексацию сайта:

- Как ускорить индексацию сайта:

- Влияние домена на индексацию

- Как закрыть сайт от индексации

Этапы индексации сайта

У поисковиков есть специальные роботы, с помощью которых поисковые системы проводят индексацию.

У Яндекса есть основной робот, который скачивает документы для их последующей индексации, его еще могут называть «спайдер» (от spider — паук), есть отдельный робот для индексации изображений, робот-зеркальщик, который определяет зеркала сайтов, быстроробот (посещает часто обновляемые сайты и практически мгновенно помещает новые страницы в индекс, при этом на их ранжирование влияют не все факторы, и после захода основного бота позиции могут измениться).

Полный список роботов Яндекса можно найти в официальной справке (однако, там есть боты сервисов, которые уже закрыты, например, Яндекс.Каталог).

У Google тоже множество ботов: робот для сканирования новостей, изображений и видео, мобильных сайтов и т.д. Полный список поисковых роботов Google можно найти в справке.

Рассматривать работу всех ботов мы не будем, достаточно понять принцип:

- Поисковая система узнает о новом сайте,

- Основной бот заходит на сайт и скачивает основные страницы для дальнейшего анализа, вся информация помещается в отдельную промежуточную базу.

- Дальше в дело вступает робот «краулер» (от crawl — ползать). Он сканирует документы из временной базы и обрабатывает контент:

- Текст. Обработка текстового контента происходит в первую очередь. После изучения данные о нем передаются в очередь на добавление в основную базу поисковика.

- Скрипты. Если на странице таковые есть, то при первом посещении страницы они игнорируются. Если краулер сканирует данную страницу не первый раз, и основная информация уже была проиндексирована, то в этом случае поисковик может попытаться определить содержимое скриптов. Грубый пример: если текстовый контент транслируется на страницу через скрипты и поисковик сумел их извлечь, то эти тексты будут добавлены в базу.

- Ссылки. Если на страницах были найдены ссылки, еще не известные поиску, то информация о них передается основному боту и, как вы понимаете, процесс повторяется.

Это сильно упрощенная модель, но ее достаточно, чтобы понять, как все устроено.

Как проверить индексацию сайта

Есть несколько способов проверки индексации страниц:

- Используя специальные операторы в поиске,

- В панелях вебмастера Яндекса и Google,

- Через сторонние сервисы или расширения.

Ниже рассмотрим каждый пункт подробнее.

Проверка индексации сайта в поиске с использованием операторов

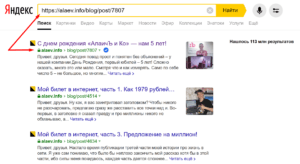

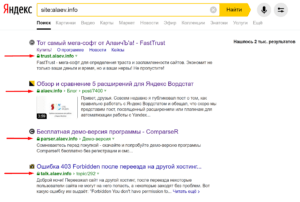

Если необходимо проверить индексацию одной конкретной страницы, достаточно просто вставить нужную ссылку в окно поиска Яндекса:

Или Google:

Если страница проиндексирована, то в результатах поиска отобразится ссылка на нее.

Но если поисковик наложил санкции на страницу или сайт, в некоторых случаях ссылка может не отобразиться. Тогда надежнее будет использовать специальные операторы:

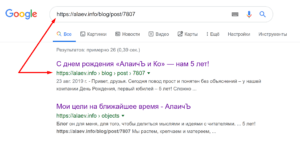

- Для Google это оператор

inurl:— запрос будет выглядеть:inurl:alaev.info/blog/post/7807, - Для Яндекса это оператор

url:— запрос будет выглядеть:url:alaev.info/blog/post/7807.

Если страница показывается в выдаче, значит она проиндексирована, а если поиск выдал пустой результат — страницы в индексе нет.

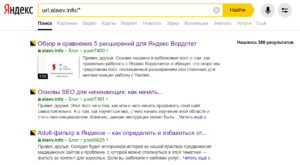

Узнать общее число проиндексированных страниц на сайте в Яндексе можно с помощью того же оператора, но нужно вводить вместо страницы только домен, а на конце вставить звездочку — url:alaev.info/*.

Вариант выше работает, если сайт доступен только по одному зеркалу, но бывает, что сайт доступен по нескольким зеркалам, например – с www вначале и без www. Чтобы учесть страницы на обоих зеркалах, можно дополнительно использовать оператор «логическое ИЛИ», выглядит он в виде прямой черты «|»: url:www.alaev.info/* | url:alaev.info/*.

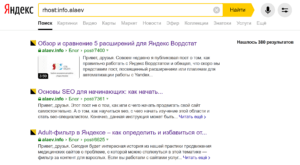

Аналогичный результат можно получить с помощью оператора rhost:. При использовании этого оператора нужно поменять местами название домена и доменную зону: rhost:info.alaev.

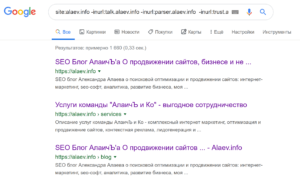

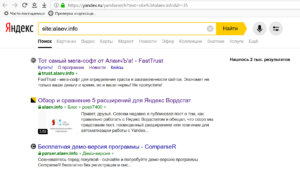

Еще один вариант – использование оператора site:, но, в отличие от предыдущего варианта, поисковик будет учитывать поддомены, если они есть.

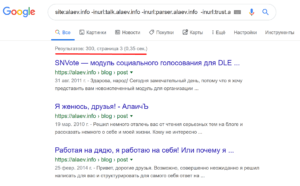

Узнать число проиндексированных страниц в Google также можно с использованием оператора site:. Если у сайта есть поддомены, то можно их отсечь с помощью оператора inurl:.

Но есть нюанс. В моем случае Google показывает 1660 результатов, а такого быть не может. Если мы перейдем на последнюю страницу поиска, то результат изменится — Google показывает всего 300 результатов.

Сам запрос мы не меняли, просто перешли на последнюю страницу. Дело в том, что Google для экономии ресурсов не просчитывает точное количество документов, и увидеть более точные цифры можно только на последней странице поиска.

Проверка индексации сайта с помощью сервисов и плагинов

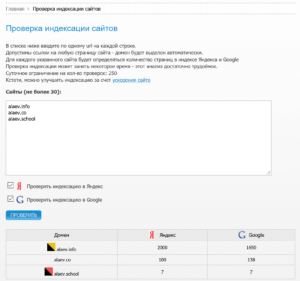

В сети много различных сервисов, которые помогают онлайн проверить индексацию сайта целиком или конкретных его страниц, обо всех рассказать не получится, но пару бесплатных сервисов мы рассмотрим.

Сервис www.seogadget.ru – проверяет общее число страниц в поисковиках и может проверять массово до 30 сайтов.

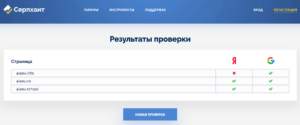

Сервис serphunt.ru/indexing – проверяет индексацию отдельных страниц и выдает только два ответа – либо страница есть в индексе Яндекса/Google, либо нет. Сервис может массово проверять до 50 ссылок.

Не знаю почему, но сервис очень долго проверяет индексацию страниц в Google (а еще выдал, что главная страница alaev.info не в индексе, барахлит иногда, зато бесплатно).

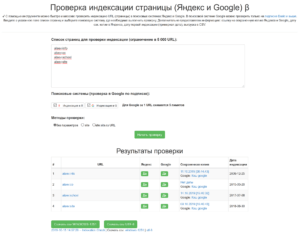

Сервис arsenkin.ru/tools/indexation/ — известный многим специалистам, проверяет индексацию страниц в Яндекс и Google. Для работы с сервисом нужна регистрация, после чего появится возможность проверить индексацию до 100 URL в Яндексе бесплатно каждый день. Работа с Гуглом доступна только по подписке, то есть платно.

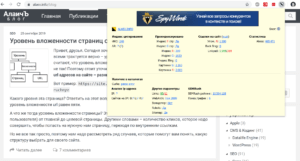

С помощью плагина RDS bar помимо проверки количества проиндексированных страниц, можно узнать еще много чего интересного, например, число проиндексированных картинок с сайта.

Букмарклеты для проверки индексации

Кроме сервисов есть еще специальные скрипты — так называемые, «букмарклеты». Чтобы ими воспользоваться, необходимо добавить в браузер закладку, запускающую скрипт при нажатии.

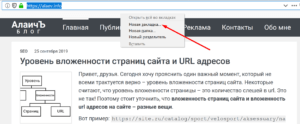

Я покажу процесс добавления закладки на примере браузера Firefox (в других браузерах принцип идентичный).

Для начала добавляем новую закладку: делайте правый клик на панель закладок, и в контекстном меню выбирайте «Новая закладка…»

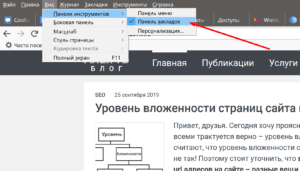

Если у вас не отображается панель закладок, нажмите Alt, вверху появится меню браузера, там выбирайте: Вид – Панель инструментов – Панель закладок:

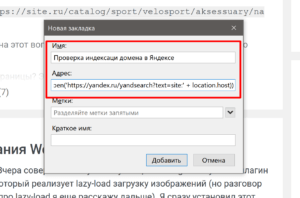

После нажатия на «Новая закладка…», откроется форма, где нужно указать произвольное название закладки (его вы будете видеть на панели закладок в своем браузере):

А в поле «Адрес:» надо будет добавить один из следующих скриптов:

- Букмарклет для проверки индексации домена в Яндексе:

javascript:void(window.open('https://yandex.ru/yandsearch?text=site:' + location.host)) - Букмарклет для проверки индексации домена в Google:

javascript:void(window.open('https://www.google.com/search?q=site:' + location.host)) - Букмарклет для проверки индексации страницы в Яндексе:

javascript:void(window.open('https://yandex.ru/yandsearch?text=url:' + document.location.href)) - Букмарклет для проверки индексации страницы в Google:

javascript:void(window.open('https://www.google.com/search?q=inurl:' + document.location.href)) - Букмарклет, который показывает доступна ли страница к индексации (проверка осуществляется на основании файла /robots.txt, наличия/отсутствия на странице мета-тега robots и link rel=canonical):

javascript:(function(){var s=document.createElement('script');s.type='text/javascript';s.src='https://arsenkin.ru/bm/robots.js';s.setAttribute('charset','utf-8');document.getElementsByTagName('body')[0].appendChild(s)})();void(0);

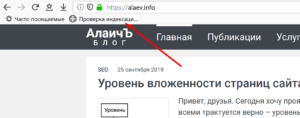

В панели появится закладка, когда мы нажмем кнопку «Добавить». Теперь можно открыть проверяемый сайт и использовать букмарклет.

В данном случае я использовал первый из списка представленных выше скриптов, который при нажатии перекидывает вас на Яндекс, подставляя адрес сайта и оператор site:.

Проверка индексации с помощью Яндекс.Вебмастера

Ваш сайт должен быть добавлен в панель Вебмастера!

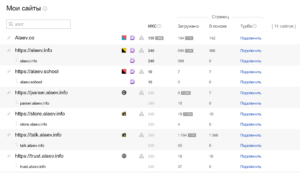

Заходим на главную страницу Яндекс Вебмастера, видим один или несколько своих сайтов, а напротив количество загруженных и проиндексированных (участвующих в поиске) страниц.

Если необходимо узнать подробнее, что это за страницы, заходим в раздел «Индексирование — Страницы в поиске» и тыкаем вкладку «Все страницы»:

А в самом низу, в правом нижнем углу будет кнопка «Скачать таблицу»:

Вы получите файл со списком всех страниц сайта в индексе Яндекса.

Проверка индексации с помощью Google Search Console

Ваши сайты должны быть добавлены в панель вебмастера Google!

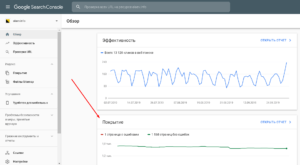

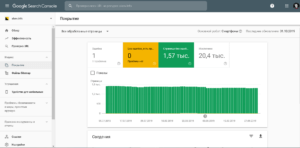

На главной странице есть дашборд «Покрытие», где указано число страниц, участвующих в поиске.

Чтобы узнать подробнее, что это за страницы:

- Нажмите «Открыть отчет» в верхнем правом углу дашборда.

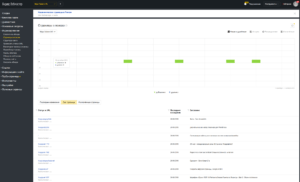

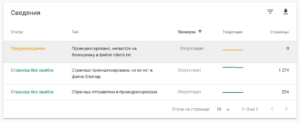

- Перед нами подробный отчет об эффективности. Информация по страницам разбита на 4 раздела: «Страницы с ошибками», «Страницы без ошибок, но с предупреждениями», «Страницы без ошибок и предупреждений» и «Исключенные страницы».

Нас интересуют отчеты «Страницы без ошибок, но с предупреждениями» и «Страницы без ошибок и предупреждений»:

- В блоке «Сведения» нажимаем на интересующую группу страниц:

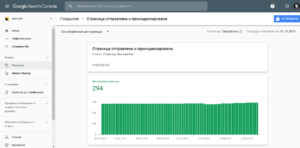

- Попадем в подробный отчет по группе страниц:

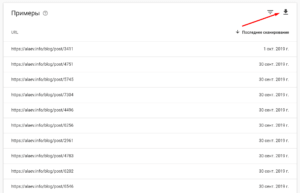

- Ниже в блоке «Примеры» можно увидеть список страниц, либо скачать список на компьютер:

Как ускорить индексацию сайта

Самый надежный способ ускорить индексацию страниц – использовать панели Яндекс.Вебмастера и Google Search Console. А еще можно простимулировать страницу ссылками или соц.сигналами.

Ускорение индексации через Яндекс Вебмастер

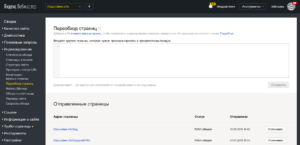

Первый способ позволяет ускорить индексацию отдельно взятой страницы (или группы страниц). Заходим в раздел «Индексирование – Переобход страниц»:

В текстовое окно нужно вставить ссылки на те страницы, индексацию которых нужно ускорить, и нажать кнопку «Отправить». Под окном ввода указан дневной лимит на количество страниц, которые можно отправить в переобход. У каждого сайта свои лимиты, но не известно, из чего эта цифра складывается (в сети гуляют различные мнения, например, что лимит зависит от суммарного числа страниц на сайте, скорости добавления новых страниц и частоты использования функционала переобхода).

Вот пара примеров для статистики:

- Для сайта с 16 000 000 загруженными страницами (из них 13 млн. страниц в индексе): «Дневной лимит — 160 адресов для сайта.»

- Для сайта с 25 000 загруженными страницами (из них 22 тыс. страниц в индексе): «Дневной лимит — 130 адресов для сайта.»

- Для сайта с 67 000 загруженными страницами (из них 39 тыс. страниц в индексе): «Дневной лимит — 140 адресов для сайта.»

- Для сайта с 38 000 загруженными страницами (из них 29 тыс. страниц в индексе): «Дневной лимит — 150 адресов для сайта.»

- Для сайта с 145 000 загруженными страницами (из них 91 тыс. страниц в индексе): «Дневной лимит — 120 адресов для сайта.»

- Для сайта с 2 600 000 загруженными страницами (из них 2,2 млн. страниц в индексе): «Дневной лимит — 150 адресов для сайта.»

Я даже посмотрел, коррелирует ли это как-то с XML-лимитами, которые выдают сайтам, – нет никакой взаимосвязи.

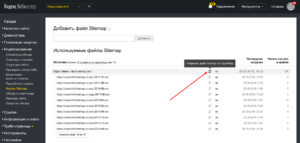

Второй способ позволяет ускорить индексацию ссылок из файла sitemap.xml, т.е. при желании можно ускорить индексацию всего сайта целиком.

Если вы не в курсе, что это за файл, читайте информацию в разделе помощи Яндекса или в справке Google.

Для ускорения индексирования ссылок из файла sitemap.xml, нужно перейти в раздел «Индексирование – Файлы Sitemap». Если файлы еще не добавлены – добавьте их (в верхней части страницы есть поле ввода с кнопкой «Добавить»). Нажмите на кнопку «Отправить файлы Sitemap на переобход».

Через какое-то время поисковый робот посетит данный файл и, если там будут страницы, о которых боту неизвестно, то он их обойдет.

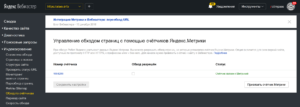

Третий способ ускорить индексацию страниц – подключить обход с помощью счётчиков Яндекс.Метрики. Для этого вам потребуется подтвердить права на сайт и в Вебмастере, и в Метрике из одного аккаунта, затем перейти в Вебмастере в раздел «Индексирование — Обход по счётчикам»:

Отмечаете галочкой «Обход разрешен», сохраняете и тогда все страницы, на которые будут зафиксированы переходы посетителей в Метрике, будут отправляться роботу Яндекса на обход. Раньше эта настройка была в Метрике, но в конце 2018 года ее перенесли.

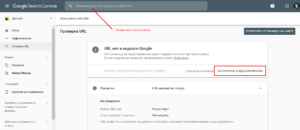

Ускорение индексации через Google Search Console

Для того, чтобы ускорить индексацию отдельно взятой страницы, необходимо вставить URL в строку проверки, а в открывшейся сводке нажать кнопку «Запросить индексацию». После этого страница встанет в приоритетную очередь для сканирования.

(Практика показывает, что индексация или переиндексация происходит почти мгновенно. Но надо еще это потестить на большей выборке сайтов, чтобы окончательно убедиться.)

Если нужно проиндексировать сразу большое число страниц, то добавьте их в файл sitemap.xml, а саму ссылку на файл добавьте в раздел «Файлы Sitemap». Чтобы ускорить обход файла, добавьте его в строку проверки URL и запросите обход страницы как было рассмотрено в примере выше.

(А в данном случае практика показывает, что бот не спешит переобходить или индексировать страницы из sitemap, ощущение, что он только для галочки говорит, что переиндексирует, а по факту обходит тогда, когда это ему положено по стандартному расписанию. То есть можно ждать бота и 3, и 5, и более дней.)

Ускоряем индексацию страниц с помощью ссылок

Чем чаще сайт публикует контент, и чем больше его аудитория, тем чаще поисковой бот сканирует страницы данного сайта в поисках новой информации. Доходит до того, что поисковой бот просто «живет» на сайте, т. е. сканирует его безостановочно (это различные новостные издания, журналы, крупные порталы и т. д.)

Наша задача — найти подобные сайты и разместить с них ссылку на свой сайт. Как правило, поисковые боты относительно быстро находят новую ссылку и переходят на вашу страницу, тем самым запуская процесс ее индексации.

Как именно получить подобные ссылки – это уже отдельный вопрос. Некоторые площадки сами предлагают разместить у них ссылку на платной основе, такие услуги можно найти в специальных биржах. Можно попробовать связаться напрямую с вебмастером (обычно все площадки, которые оказывают подобные услуги, указывают у себя контакты администратора сайта).

Много лет назад можно было ускорить индексацию, размещая ссылки на нужные страницы в соцсетях, самой популярной площадкой для этой цели был Twitter. Но очень быстро в соцсетях прочухали такое злоупотребление и добавили сперва к ссылкам атрибут rel=”nofollow”, запрещающий роботам переходить по ссылкам, а потом стали ставить ссылки через прокладку с редиректом. Поисковики тоже обратили внимание на ситуацию и перестали доверять таким сигналам.

Еще поисковые роботы «живут» на различных блог-платформах, типа ЖЖ, там тоже можно размещать посты со своими ссылками, но если честно, я не вижу в этом большого смысла, сейчас и Яндекс, и Гугл довольно оперативно заходят на сайты и сканируют все полезные страницы, а индексация занимает не больше недели. Раньше поисковикам, видимо, не хватало мощностей, и приходилось прибегать к различным хитростям, иначе можно было ждать индексации неделями, а то и месяцами.

Есть еще один способ мгновенно проиндексировать страницу – запустить рекламную кампанию в Яндекс.Директ или Google Ads (на самом деле, рекламу можно и не запускать, а просто создать объявления). Страница, на которую ведет ссылка из рекламного объявления будет вне очереди добавлена в базу поисковой системы.

Влияет ли название домена и доменная зона на индексацию

Ответ – нет. На сегодняшний день существуют тысячи различных доменных зон, не только связанных с названиями стран, как это было изначально задумано, но и ассоциирующихся с направлением и деятельностью бизнеса, предметами или событиями.

Есть и популярные в нашей стране кириллические доменные зоны. Когда они появились, были проблемы с их индексацией, но теперь это в прошлом. Однако с кириллическими доменными зонами могут возникнуть иные проблемы, например, ограничения для почты для домена, могут возникнуть проблемы со ссылками, потому что для совместимости домены преобразуются в так называемый punycode (например, домен алаичъ.рф будет выглядеть как xn--80aayk6ds.xn--p1ai), а адреса выглядят совершенно непривлекательно (наверняка вы часто такое видите на Википедии): https://ru.wikipedia.org/wiki/%D0%97%D0%B0%D0%B3%D0%BB%D0%B0%D0%B2%D0%BD%D0%B0%D1%8F_%D1%81%D1%82%D1%80%D0%B0%D0%BD%D0%B8%D1%86%D0%B0

Как бы то ни было, сейчас все это прекрасно будет индексироваться и ранжироваться во всех поисковых системах.

А когда-то проблемы были, я даже пост писал в 2010 году о том, как заставить Rambler индексировать мой блог, который расположен на .info домене. Рамблер не хотел его индексировать 2 года. Хотя чего уж там… самого поиска Рамблера давно уже не существует (имеется в виду, что собственной поисковой системы не существует, а поиск работает на технологиях Яндекса)!

Как закрыть сайт от индексации

Выше мы рассмотрели примеры, как проверить и ускорить индексацию страниц сайта, но иногда требуется ограничить индексацию отдельных ресурсов. Например, если на сайте есть страницы-дубли и нам нужно оставить в индексе одну страницу, а индексацию второй запретить.

Существует несколько способов:

- Запретить индексацию в файле robots.txt – вариант подходит для Яндекса, т.к. все, что закрыто в этом файле от индексации, из выдачи также удаляется. Но Google воспринимает данный файл только как рекомендацию. Если на страницу стоят ссылки с других ресурсов, то эта страница может появиться в индексе, хотя и с пометкой, что ее содержимое скрыто в robots.txt. Я про это подробно писал в посте Особенности индексации сайтов – robots.txt, мета-тег robots.

- Поставить на странице мета-тег <meta name="robots" content="noindex, nofollow"/>.

Подобные страницы относительно быстро вываливаются из индекса после переобхода поисковым ботом. Работает хорошо в обоих поисковиках.- Вариант только для Яндекса:

<meta name="yandex" content="noindex, nofollow"/> - Вариант только для Google:

<meta name="googlebot" content="noindex, nofollow"/>

- Вариант только для Яндекса:

- Установка на странице HTTP-заголовка X-Robots-Tag. Преимущество перед мета-тегом в том, что HTTP-заголовок может быть размещен вообще на любом документе, например PDF, изображении и др.

- Настроить на страницах тег link rel=”canonical”. Это решение помогает склеить страницу-дубль с каноничной страницей. Способ хоть и проверенный, но не дает 100% гарантии срабатывания, т. к. поисковиками воспринимается не как строгое правило, а как рекомендация, следовательно, поисковики могут сами решать следовать ей или нет.

- Запаролить вход на сайт через .htaccess и .htpasswd. В этом случае поисковой бот не сможет зайти на сайт и просканировать его. Не обязательно закрывать весь сайт, можно только отдельные разделы или страницы. Минус данного способа: он только ограничивает индексацию и, если страницы уже находятся в индексе поисковиков, то их сперва нужно из него удалить.

- Индексацию ссылок с параметрами можно ограничить в /robots.txt для Яндекса и в Search Console для Google. Это такие URL, у которых имеется вопросительный знак, после которого задается один или несколько параметров со значениями.

Пример:www.site.ru/index.php?page=1, где «page» — это параметр, а «1» — его значение.

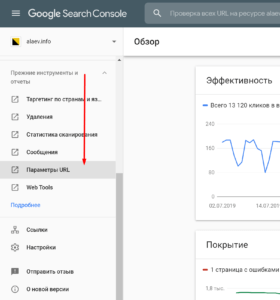

Запретить индексацию подобных ссылок в Google можно в Search Console в разделе «Прежние инструменты и отчеты – Параметры URL»

Только вот есть один косяк, так как это устаревший инструмент, он может не работать для сайтов подтвержденных через DNS (а не с помощью html-тега, txt или html-файла): «Отчеты и инструменты прежней версии сервиса недоступны для доменных ресурсов.» Это может случиться, когда вы добавляли основной домен как «Ресурс-домен», чтобы всего его поддомены не надо было отдельно подтверждать. Я для своего блога делал именно так, ибо не хотел париться с каждым поддоменом отдельно. Но у вас, скорее всего, будет все нормально! Подробнее о самой настройке инструмента читайте в официальной документации.

Только вот есть один косяк, так как это устаревший инструмент, он может не работать для сайтов подтвержденных через DNS (а не с помощью html-тега, txt или html-файла): «Отчеты и инструменты прежней версии сервиса недоступны для доменных ресурсов.» Это может случиться, когда вы добавляли основной домен как «Ресурс-домен», чтобы всего его поддомены не надо было отдельно подтверждать. Я для своего блога делал именно так, ибо не хотел париться с каждым поддоменом отдельно. Но у вас, скорее всего, будет все нормально! Подробнее о самой настройке инструмента читайте в официальной документации.

У Яндекса похожий функционал реализован с помощью директивы Clean-Param, которая указывается в файле /robots.txt. Подробности можно узнать в разделе помощи Яндекса. - Удаление ссылок через панели Яндекс.Вебмастер и Search Console. С помощью данных инструментов можно удалять из выдачи ненужные ссылки. В Google есть особенность: ссылки не удаляются из поиска, а скрываются на некоторое время. Разумеется, если после удаления страницы из индекса не ограничить саму возможность индексации, то страницы могут вернуться в индекс снова.

В Google Search Console есть хитрость, о которой не все знают. Если целый сайт случайно проиндексировался (такое часто случается при разработке), то можно очень быстро удалить его из выдачи – просто оставьте поле для ввода ссылки пустым и нажмите кнопку удалить. Весь сайт будет удален. Это самый быстрый способ удаления ссылок из выдачи. - Настройка редиректа на другие страницы (склейка страниц). Если страница находилась в индексе, то после настройки с нее редиректа, в индекс попадет та страница, на которую настроен редирект. Важно, чтобы сервер отдавал 301 код редиректа, а не 302 (такое бывает часто). Подробнее про 301-редиректы.

- Настройка кодов 404 или 410 – обычно сервер отдает такие коды, если страница удалена, однако можно настроить данные коды на рабочих страницах, тогда поисковики будут считать их удаленными и выкинут из индекса. Данный способ я описал больше для теории, потому что на практике такое вряд ли кому-то придет в голову реализовывать: можно аналогичный эффект получить в несколько раз попроще, используя вышеописанные методы.

Думаю, на этом можно и остановиться. Я рассказал вам подробно об основных способах проверки индексации сайтов и отдельных страниц, показал инструменты, а также рассказал о том, как можно ускорить попадание страниц в индекс поисковых систем Яндекс и Google.

Но если остались какие-то вопросы или у вас есть, что добавить, смело пишите в комментариях.

Спасибо за внимание, друзья.

До связи.

Как всегда шикарно!

Ты чЁ, недавно из анабиоза вылез, чувак?

Какая индексация, сайтам кердык скоро, а он тут нам Великие Истины открывает!

Как говорил Уильям наш Шекспир — "Очнись, ты дрищешь"!

Без обид, но реально, твоя инфа устарела минимум лет на 5!

"сайтам кердык скоро" — окей, все понял. Пошел заниматься не сайтами...

Почему картинки не выровнять по середине как раньше?

2 Арнольд Иванович

Это ты устарел мне кажется

Решил, что выравнивание по центру — устарело и не тру...

"миниатюры" то можно было и покрупнее сделать в 3 раза, место же позволяет, и не пришлось бы в большинстве случаев лишний раз кликать на увелич размер

Да, верстка статьи устарела лет на пять.

Шрифт мелкий, ширина контента нечитабельная.

Картинки зачем-то аватарками залиты...

Не хочу читать.

Сейчас бы выбирать что читать или не читать, ориентируясь на устаревшую вёрстку.

Я проверял >1000 страниц на индексацию десктопной прогой YCCY.

Загружаешь туда УРЛы и прога сортирует по УРЛам: в индексе/не в индексе

Она еще жива, старушка эта? Я думал, что YCCY давно уже канула в лету...

Приветствую!

А входящие ссылки на индексацию вот не проверить-сервисы показывают только данные у поисковиков-т.е у основного робота, а вот быстробота они не учитывают...

Проверил руками вставляя ссылку в поиск-показывает что найдена, но не в одном сервисе её нет, т.е в индекс не залетела ссылка!

Как быть и чем проверять?)

Цель владельца сайта — чтобы все страницы, открытые для индексации, были в индексе поисковой системы. Достичь этого сложно. К тому же важно следить за процессом занесения страниц в индекс, то есть резкие изменения в положительную или отрицательную сторону в любом случае, это сигнал о проблеме.

>>Достичь этого сложно.

Нет ничего сложного что бы проиндексировать весь сайт.

Как всегда шикарно!

Почему картинки не выровнять по середине как раньше?

Спасибо за статью! Я например вот тут https://iksweb.ru/tools/indexation/ проверяю дату индексации страниц в Яндексе.

Тоже фигня, не показывает что ссылка в индексе!

Спасибо за статью. У нас тоже запустился сайт по материалам lepnina.su, тоже анонс статью думаем где-то сделать.